|

撰文 / 採訪整理:江沛航 在資訊爆炸的時代,數位藏品和數位平台呈現著豐富而迷人的樣貌,為了讓各種數位化物件豐富我們的生活,數位化技術不斷地推陳出新,文字、靜態影像、音訊資料及影音資料等數位藏品因此亦趨豐富,讓我們的生活更加多采多姿。中央研究院資訊科學研究所的廖弘源研究員多年來擔任〈數位典藏與數位學習國家型科技計畫:分項二、數位技術研發與整合計畫〉主持人,在開發數位典藏相關技術上更是不遺餘力,讓民眾近用數位藏品更加便利。趁著一次難得的機會,我們特別邀請廖研究員接受訪問,為大家介紹這些讓數位化物件變得完整、清晰又好用的多媒體技術。

一、影像 / 視訊修補技術

圖1:影像修補前→影像修補後影像修補技術和視訊修補技術的概念,主要是對於畫面上髒汙、雜點等指定區域,藉由區域外的其他完好畫面來重建原本的畫面內容,如下圖2,即是經過修補技術後,重現沙灘原本的樣貌。

圖2:原始畫面→指定修補區域→重建畫面

在修補技術當中,小範圍的影像破損或雜訊,可以簡單地利用內差像素(Pixel Interpolation)的方式修復;大範圍的修補,則需要利用補丁(Patch)填補方式修復。由於影片中常常包含大量的人物動作,較一般的場景更為複雜,因此廖研究員的研究團隊針對人體運動進行運算,合成人體姿勢後,預測接下來的動作;並利用建立完整的運動(Motion),建構出變動位置圖(Motion Map);更利用新的演算方式,讓補丁重現後的影格(Frame)樣貌更加穩定,讓視覺上更加平滑,並且亮度一致。也讓數位化工作人員在對老影片進行修復時,只要在修補軟體中進行簡單操作,就能夠針對受損資料進行大範圍的視訊修補。

二、自動視訊分鏡技術

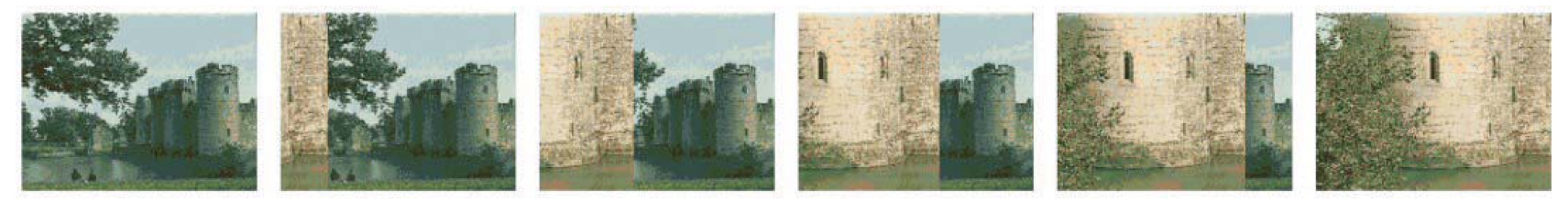

圖3:雨刷效果

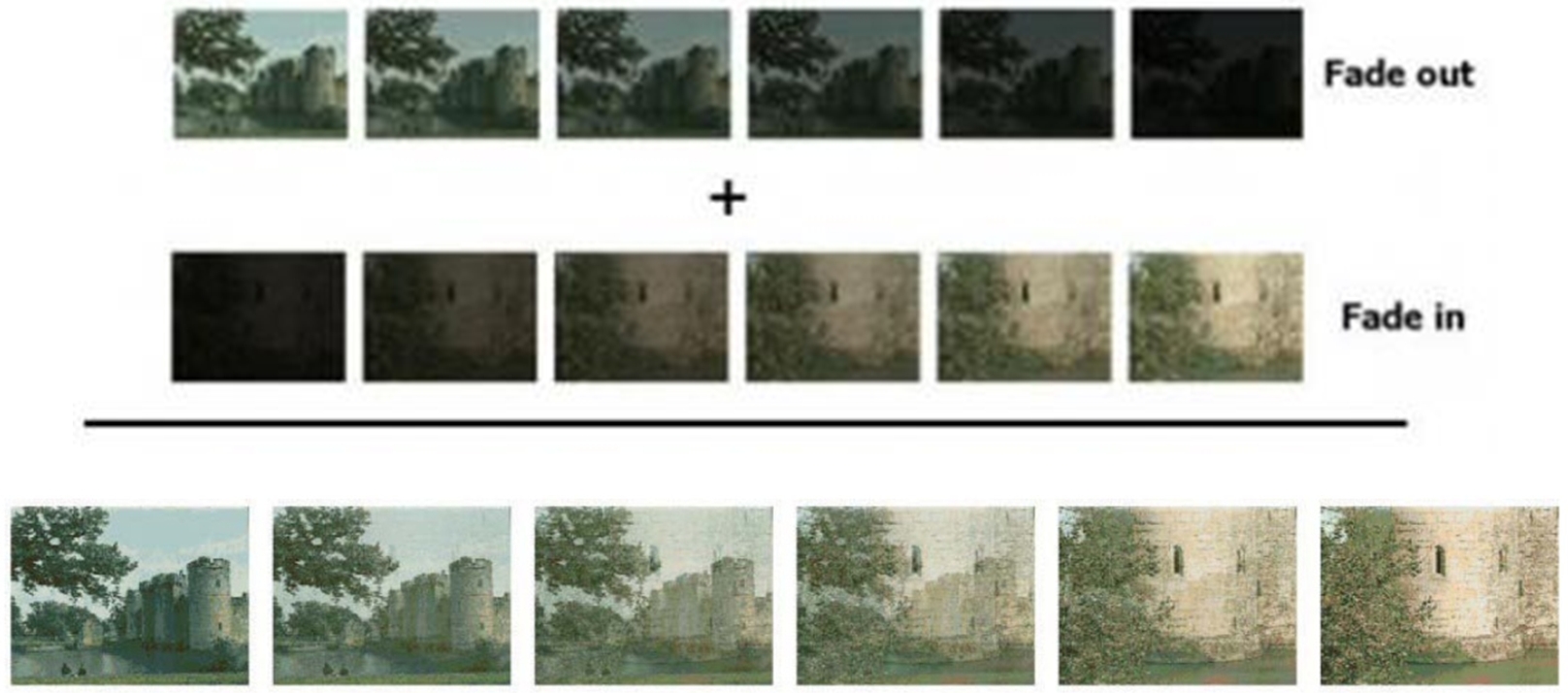

圖4:淡入效果+淡出效果→溶解效果

在幾種視訊轉換中,Dissolve效果因為經常用到又較難區別,因此成為重要的研究方向。自動視訊分鏡技術(Shot Change Detection)首先以區隔運動和慢換景為切入點,如影片中單一物體移動的「區域運動」(Local Motion),或是因攝影機動作讓整個畫面一起移動的「全區運動」(Global Motion)。過往的自動分鏡技術因為無法妥善區別「運動」和「換景」的不同,故效果不甚理想,此技術則正確地定義「溶解式慢換景」,有效地區隔視訊中的「運動」及「換景」這兩種不同的事件,也替「視訊檢索」系統的開發打下良好基礎。

圖5:自動視訊分境技術所偵測到的段落轉換

這份研究成果於2005年刊登在多媒體領域的指標性期刊IEEE Transactions on Multimedia上,被認為是世界上最強健的慢換景偵測技術之一。為了讓數位典藏相關計畫能夠善用此技術,廖研究員也與國立臺北藝術大學合作,將此技術應用於〈視聽資料數位影音資料庫數位化建置計畫〉,並且整合進多媒體核心平台,希望讓台灣的影音資料數位典藏擁有更快速、更方便、更強大的檢索工具。

延伸閱讀:(1)C. H. Ling, Y. M. Liang, C. W. Lin, Y. S. Chen, and H. Y. Mark Liao, "Human Object Inpainting Using Manifold Learning-based Posture Sequence Estimation," IEEE Trans. on Image Processing, volume 20, number 11, pages 3124-3135, November 2011. (2)Nick C Tang, C. T. Hsu, C. W. Su, T. K. Shih, and H. Y. Mark Liao, "Video Inpainting on Digitized Vintage Films via Maintaining Spatiotemporal Continuity," IEEE Transactions on Multimedia, volume 13, number 4, pages 602-614, August 2011. (3)C. H. Ling, C. W. Lin, C. W. Su, H. Y. Mark Liao, and Y. S. Chen, "Virtual Contour Guided Video Object Inpainting Using Posture Mapping and Retrieval," IEEE Transactions on Multimedia, volume 13, number 2, pages 292-302, April 2011. (4)C.-W Su, H.-Y. Mark Liao, H.-R. Tyan, K.-C. Fan, and L.-H Chen, "A Motion-Tolerant Dissolve Detection Algorithm," IEEE Transactions on Multimedia, volume 7, number 6, pages 1106-1113, December 2005. |

|

|